日々の不確実性に向き合えるのが人間

── 「未来の再創造」というテーマの展覧会で、徳井さんに出展を依頼されたのはどんな理由からですか。

畠中 ── AIについての作品を何か入れられないかと考えていました。単純に技術を礼賛するのではなく、発展していくものに対して、負の面も同時に見ていく。テクノロジー批判をテクノロジーによって行なうということが、メディアアートのひとつの批評性でした。

AIの世界では「シンギュラリティ*1」ということが何年か前に大きく取り上げられて、「2045年には人間の知性を超える」という話題が盛り上がりました。今になって、ようやく冷静に「AIというのはどういうものなのか」「社会に実装された時にどういう役割を果たすか」というトピックを考えられるようになってきたとも言えます。今日ではAIというものに対する僕らの考え方も少しずつ変わってきているのではないですか?

徳井 ── そうですね。技術が思っていた以上に進歩していくという認識の一方で、AIにできることは本質的には変わらないことが見えてきたから、両方の側面があります。

技術的な進歩のスピードでいうと、まさに加速度的に伸びているのですが、やればやるほど、人間の能力の方にこそ伸びしろがあるということが見えてきたと思います。

データ内の、あるパターンを学習することに関してはAIは得意ですが、それを一般化することができない。囲碁のチャンピオンにAIが勝って、シンギュラリティはすぐそこまで迫っているんだということを仰る方も多かったのですが、囲碁というのはルールがかっちり決まっていて、盤の中で起きることですから偶然性も入っていないですし、純粋に戦略的な論理で物事が決まっていく世界です。

それに比べ、僕ら人間がやっていることって、5歳の子どもでも日常の不確実性と向き合って生きていますよね。だから、囲碁などの限定的な世界では人間を打ち負かすようになりましたが、実は人間がやっている活動のごく一部であることが明らかになった感じがしています。

畠中 ── 人間は赤ん坊であっても、外界の環境情報の中で柔軟に学習していくことができます。AIは量はすごく勉強するのだけど、そういった柔軟性というものがまだない。

さまざまな専門家にヒアリングしても「シンギュラリティは来ない」という意見が多くなりました。ただし「ある」という仮定をすることによって、人間の思考が進むことがあります。

徳井 ── シリコンバレーなどはわかりやすいですよね。「シンギュラリティが来る」という未来をぶち上げておいて、そこに向かっていろんな研究所をつくったり、投資をつぎ込んだりして前進していますから。

畠中 ── ただ、人間の能力をAIが超えるというのは、可能性としては残されているわけです。そう仮定した時、人間はどう振る舞うのか。その可能性を対象化することで、初めて判ることもあります。

エンコーダーとデコーダーを介する機械翻訳

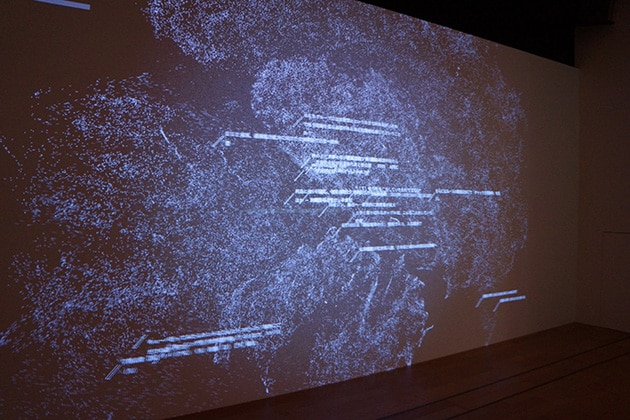

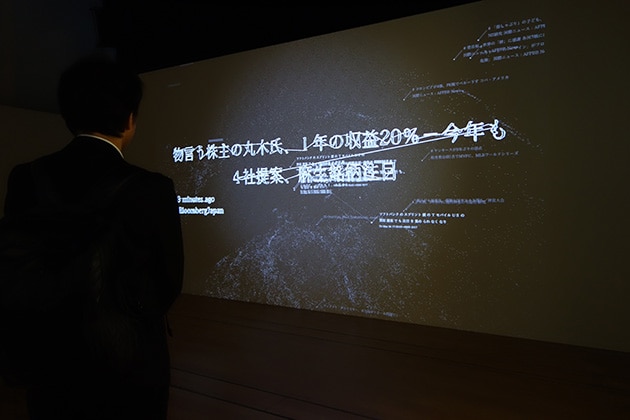

徳井 ── 今回出展した「The Latent Future——潜在する未来」は、完全に新作です。展覧会のテーマ解説とともに、作品を探しているという話を畠中さんからいただいた時、すでに構想とそれを実現する技術を用意していました。

|

ニューラルネットワーク*2を用いた言語モデルでは、ある文章をエンコーダーとデコーダー*3、2つのネットワークを使って変換します。

一般の機械翻訳などでは、例えば日本語の文章であれば、「日本語」のエンコーダーを使って、ある「特徴ベクトル」の空間、つまり数字の列に変換しておき、今度は「英語」のデコーダーを使って変換する。そうすれば、英語として出力されます。機械翻訳をざっくり説明すると、こういうことです。

|

中間にある特徴ベクトルの空間は単に数字の列で、言語に依らない空間なんです。「これはコップです」という文章は、日本語でも、英語でも、概念自体は一緒ですよね。

ベクトル空間のどこかに「これはコップです」という概念があって、日本語で変換しても、フランス語で変換しても同じになるように言語モデルの学習を進めます。それをそれぞれの言語のデコーダーで変換することで、複数の言語の間の機械翻訳が成り立っています。

さらに面白いのは、「これはコップです」という概念のすぐ横には、「これはグラスです」という概念が入っていたり、「これはボトルです」というのがさらに近くに入っていたりするのです。関連する文章、あるいは似た概念の文章が近くに位置付けられるという性質が言語モデルの空間にはあります。

|

[ 脚注 ]

- *1

- シンギュラリティ:人工知能の高度な発達により、科学技術を進歩させるのが人類ではなくなるという将来の時点。技術的特異点ともいう。数学者ヴァーナー・ヴィンジと、発明者・フューチャリスト(未来学者)のレイ・カーツワイルにより提示された概念で、2045年に訪れるとの説が提唱された。

- *2

- ニューラルネットワーク:脳の構造を工学的に再現した神経回路網のモデル。

- *3

- エンコーダーとデコーダー:あるデータを暗号化するため、符号(コード)の集まりに変換処理する装置または電子回路をエンコーダーという。デコーダーは符号化(デコード)時とは逆方向の変換を行い、元のデータを復元(デコード)する装置または電子回路のこと。