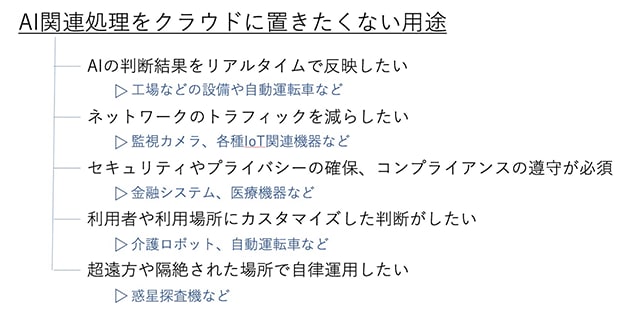

AIを現場に置きたいニーズは多い

リアルタイム性が求められる応用以外にも、AI関連の処理をクラウド側だけに託しておくことができない応用が数多くある(図4)。

|

まず、AIへの入力が動画のような大容量のデータになる場合。入力データの全てをクラウドに上げようとすると、ネットワークのトラフィックをいたずらに増大させてしまう。例えば、監視カメラの映像から不審者を見つけ出すAIシステムでは、取り込んだ映像をすべてクラウドに送っても、そこに写っているモノは道路だったり、街路樹だったりと判断対象にはならないものばかりだ。できれば監視カメラの内部で不審者を判別し、精査が必要な部分だけをデータセンターに送れるようにしたい。

次に、セキュリティやプライバシーの確保、企業コンプライアンスの観点から、クラウドにデータを送りたくない用途もあるだろう。AIで扱うデータは、生産ラインでの稼働条件や生産状況、巨額の資金をやり取りする流れ、重要施設の管理情報、個人情報の極みと言える生体情報など、できれば手元から離したくないものも多い。機密データを基にした判断は、手元の機器中だけで扱いたいというわけだ。

さらに、個人や利用する場所ごとの要求に合わせた応用。例えば、介護ロボットなどでは、それを利用する人や場所に合わせてAIによる判断をカスタマイズしたいだろう。また、自動運転車も同様である。バスやタクシー、トラックなど公共性の高いクルマはデータセンターでの運転スキルの共有の効果が大きい。しかし、個人が愛車となるクルマを購入する場合には、自動運転車であっても住んでいる街の状況やライフスタイルに合わせてカスタマイズしたいという要求が出てくる。

最後に、クラウドにつないだAIの運用が物理的にできない場合。例えば惑星探査機のような極めて遠方に送り込む機器、さらには地中や深海など隔絶されて十分な通信手段が確保しにくい状況にある機器を自律運用するためのAIがそれに該当する。この場合、機器の中でAIシステムを完結させる必要がある。

これらの応用では、少なくとも推論処理を、理想的には学習処理も、クラウドに頼らなくて済む方法が求められる。現場に置いた機器の中で、どれだけ高度なAI関連処理を実行できるかが、AIの応用を広げるうえでの鍵になると言える。

既存チップの仕様は「帯に短しタスキに長し」

先に挙げた、AI関連処理を実行できる演算能力を確保するための2つのアプローチのうち、データセンターを活用する方法が応用を制限することになるとすれば、解決にはもう1つの方法を追求していくしかない。そこで、AIチップの出番となる。

現時点では、AI関連処理で多用する積和演算を、高速実行するのに適した構造で作られているGPUやFPGAが、現場の機器中に組み込まれている。ここに学習済みのAIをコピーすることで、ある程度の推論処理を実行できるようになるのだ。ただし、潤沢な演算能力を持つデータセンターのようには、高度な処理を実行することはできない。また、用途によっては、びっくりするほど多くの電力を消費することになる。つまり、推論処理を実行できるとはいっても、かなり不自由な状態だと言える。ましてや、学習処理まで現場の機器中で実行するとなるとその実現はまだ先のことだ。

では実際には、どの位のことが既存のGPUやFPGAでできるのか、クルマに搭載する高度運転支援システム(ADAS)を例に取って紹介しよう。現時点で流通している既存チップは、AI関連処理を実行することを念頭に置いて設計されているわけではない。こうした汎用型の既存チップをAI関連処理に使うことが、いかにチグハグな状況を生んでいるのか感じていただければと思う。

ADASでは、カメラで取り込んだ画像を認識して、「歩行者」「植物」「車両」「標識」「建物」「道路」など約10種類程度に分類できれば十分である(図5)。クラウド上のビッグデータ分析では、1000種類もの項目に分類することがあるが、ADASではそこまで複雑な仕分けはしない。そして、認識対象となる画像データの大きさは、100万画素から200万画素といったところである。ただし、人命にかかわるシステムであるため、認識精度は高くなければならない。

|

こうした条件でAIの推論処理をさせると、GPUならば1秒当たり約3000フレーム、FPGAも同等の画像を処理できる。カメラのフレームレートは15〜30フレーム/秒なので、現在のGPUやFPGAの多くがオーバースペック状態だといえる。ただし、今後はADASの処理が高度化することが予想され、余裕があることは一概に無駄であるとは言えない。一方、消費電力はGPUでは200W以上、FPGAでは約75Wである。認識システムを冷却ファンなしで利用するためには消費電力を5W以下に、安定動作とコストを勘案するとできれば1Wに近づけたい。この条件は、チップの能力を落として使えば、現時点でギリギリ要求値を満たすことができる値だ。ただし既存のチップでは、消費電力を要求範囲内に抑えながら、解像度やフレームレートを高めたり、カメラの数を増やしたり、さらに高度な認識処理に対応していったりする余裕はない。