JavaScriptが無効になっています。

このWebサイトの全ての機能を利用するためにはJavaScriptを有効にする必要があります。

- Science Report

- サイエンス リポート

目的達成に向けて自律的に業務遂行する「AIエージェント」の最前線

- 文/伊藤 元昭

- 2026.03.04

2022年末の「ChatGPT」の登場以来、生活やビジネスシーンの中で「AI」の活用が急速に進んだ。メールの代筆、資料の要約、プログラミングの補助――。多くのビジネスマンが、AIを「便利な道具」として使いこなし始めている。ところが今、AIの活用法が、早くも次の段階へと進みつつある。指示したことに答えるだけの「ツール」だったAIが、自律的に判断して目的を完遂する生活やビジネスの「パートナー(エージェント)」へと、進化してきた。

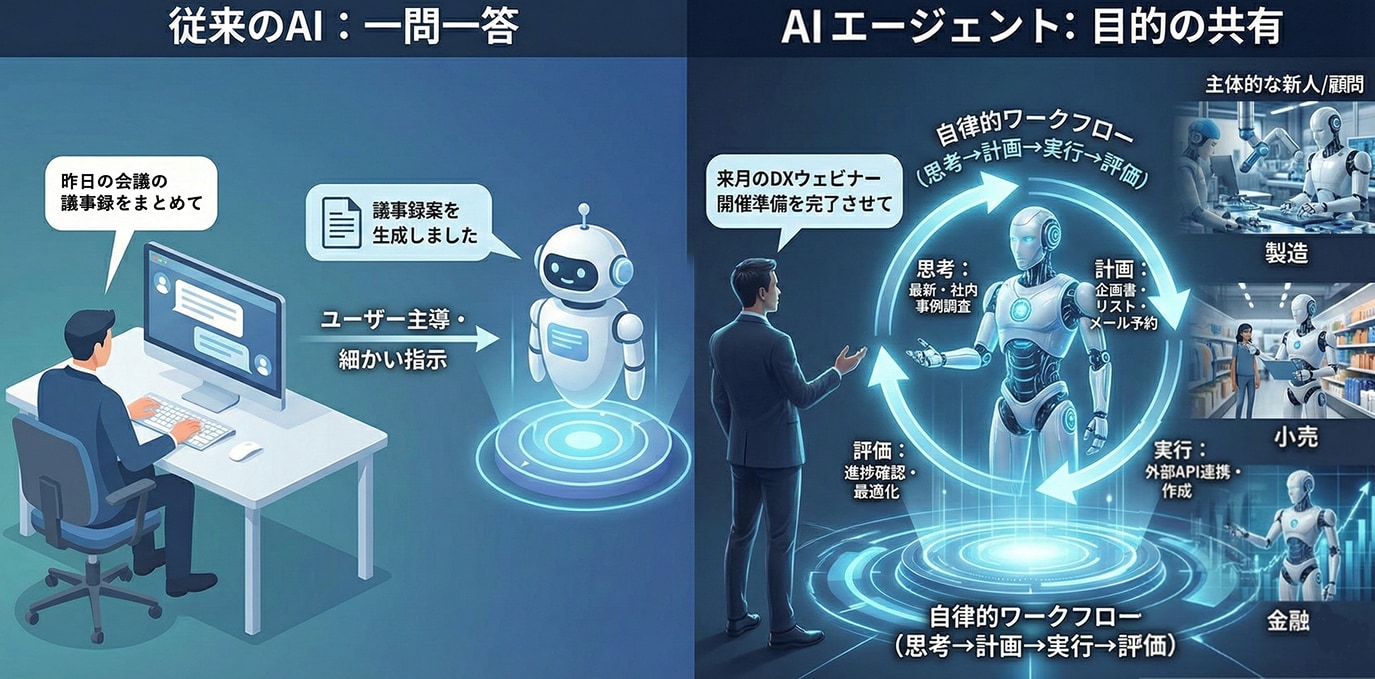

「一問一答」から「目的の共有」へ

これまでのAI活用は、どんなに進んだ生成AIであっても、ユーザーとの間で「一問一答」を交わしながら利用する形となっていた(図1)。「昨日の会議の議事録をまとめて」と指示(プロンプト)を出すと、AIがそれに応えるといった具合だ。こうしたAIとユーザーの関係性においては、主導権と「次に何をすべきか」を決める判断は常にユーザーである人間にあった。

- [図1]指示で動く「ツール」だったAIが、目的に向けて自律的に動く「パートナー(エージェント)」へと進化

- 作成:伊藤元昭(Googleの生成AI「Nano Banana Pro」を利用)

一方、現在注目を集めている「AIエージェント」は、全く異なる。ユーザーがAIに与えるのは、細かい指示ではなく、AIが達成すべき「目的」となる。「来月、製造業の顧客向けに、最新のDX事例を紹介するウェビナーを開催したい。企画書の作成、登壇候補のリストアップ、集客用メールの配信予約までを完了させて」と伝えておけば、AIエージェントは、自らインターネットで最新事例を調査して、社内の過去の成功事例などを参照し、必要であれば外部のAPI(アプリケーション・インターフェース)を操作してメールの下書きまで作成してくれる。「思考→計画→実行→評価」という自律的な作業ループ(エージェント・ワークフロー)を持つことが、これまでのAIとの最大の違いである。

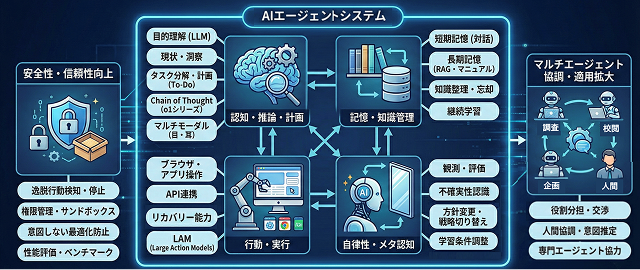

AIエージェントの進化を支える要素技術

AIエージェントを実現し、より高度に進化させていくためには、単にAIモデルの性能を高めるだけでなく、複数の要素技術の統合と成熟が不可欠になる。具体的には、「認知・推論・計画」「記憶・知識管理」「行動・実行」「自律性・メタ認知」に相当する4つの要素技術AIを統合する必要がある(図2)。

- [図2]AIエージェントを実現し、高度化するための要素技術

- 作成:伊藤元昭(Googleの生成AI「Nano Banana Pro」を利用)

認知・推論・計画に相当する機能を担うAIは、まず、大規模言語モデル(LLM)を活用して目的を理解し、与えられた目的に対して「今、何が起きているのか」「次に何をすべきか」を把握・洞察する。抽象的な目的を「まずAを実行し、次にBを確認。もしダメならCへ行く」といった小さな具体的タスクに分解。AIが自ら「To-Doリスト」を作成して、優先順位をつけて長期的計画を立てる。状況に変化が生じれば、再計画する能力も必要だ。最新のAIモデル(OpenAIのo1シリーズなど)は、答えを出す前に「じっくり考える(Chain of Thought)」ステップを踏むようになった。これにより、これまで苦手だった複雑な数学的推論や、長期的なプロジェクト管理の精度が飛躍的に向上している。また、これまでのAIは主に「テキスト(文字)」で動いていたが、最新のAIエージェントは「目(カメラ・画面認識)」と「耳(音声認識)」の情報を統合して活用できるようになった。

記憶・知識管理に相当する機能を担うAIは、経験を蓄積する「知識庫」として機能する。過去の対話内容を覚えている「短期記憶」と、社内の膨大なマニュアルや専門知識を参照できる「長期記憶(RAG技術など)」の両方を使い分ける。これによって、会話の文脈に沿った判断が可能になる。重要度の整理や忘却の管理、さらには知識を継続的に学習し、新しい知識を統合したり、既存の知識との矛盾を解消したりする機能も必要になる。

行動・実行に相当する機能を担うAIは、ブラウザを操作して情報を調べたり、Excelなどアプリケーションソフトを操作して計算したり、ビジネスチャットなどを用いて人間にメッセージを送ったりする。API(アプリケーション間の接続窓口)などを介して、デジタル世界にある様々な道具を使いこなす際、それぞれのツールを、いつ・どのように使うのか適切に判断し、それぞれの活用を制御する。また、行動に失敗した際のリカバリーを考えておく能力も求められる。近年、「Large Action Models (LAM)」と呼ばれる、コンピュータ上の操作(アクション)を学習したモデルが登場している。ウェブサイトの予約フォームへの入力や、複雑な業務システムの操作を、人間が操作する動画を学習することで習得する技術である。これにより、AIが操作できるアプリの範囲が爆発的に広がっている。

自律性・メタ認知に相当する機能を担うAIは、行動後の現実世界や仮想世界の状態を観測し、行動した結果を評価して次の行動に自律的に反映させる。特に、不確実性や限界を認識し、必要に応じて方針変更や行動戦略を切り替える柔軟さが求められる。さらに、行動の結果に基づいて、AIモデルの学習条件を調整し、より効果的な学習ができるようにしておく。

マルチエージェント協調や安全性・信頼性向上による適用シーンの拡大

以上がAIエージェントを実現するための基本的な要素技術であるが、より複雑・大規模な業務をこなすため、適用シーンを拡大するために、その他の要素技術を併用する場合もある。

協調性・社会性に相当する機能をAIエージェントに付与して利用する場合がある。複数のAIエージェントを協調活用して役割分担したり、人間と協調してそれぞれが得意な作業に注力したり、指示の曖昧性を解消したりする。マルチエージェント協調では、適切に分担・交渉・合意形成する技術や他エージェントの意図推定技術、競合・協調環境での戦略形成技術が必要になってくる。人間との協調では、背景情報から曖昧な指示を解釈する技術やエージェントの行動意図を説明可能にする技術、信頼形成や介入の可能性に向けた技術が必要になる。1つの「万能AIエージェント」を作るのではなく、「企画担当エージェント」「調査担当エージェント」「校閲担当エージェント」など、複数の「専門AIエージェント」を適材適所で用い、連携させてアウトプットの質を自己修正的に高められる仕組みを導入する機運が高まっている。

また、人命や財産などに関わる業務を行う際には、安全性・信頼性を高めるための機能を併用する必要が出てくる。こうした機能があれば、AIエージェントの適用範囲をより拡大できるようになる。安全性・信頼性を高めるための具体的アプローチには、一定条件を逸脱した行動を検知して必要に応じて停止する機能、権限管理やサンドボックスの機能、意図しない目的最適化の防止などがある。さらに、エージェントの行動をベンチマークし、長期にわたるタスクに対する性能評価や失敗事例の体系化などに向けた技術も必要になってくる。

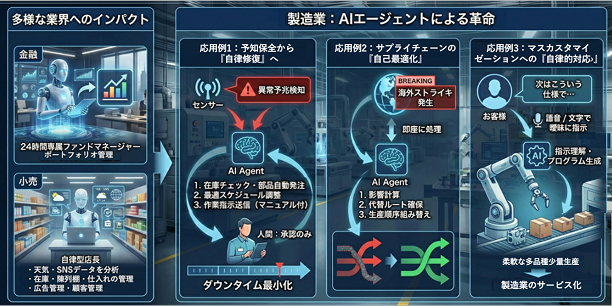

業界別・AIがもたらす「革命的」ビジョン

AIエージェントを活用することによって、多様な業界のビジネスに新たな価値が生み出される可能性が見えてきている。例えば、金融業では、市場の急変を察知して自律的にポートフォリオを組み替える「24時間稼働の専属ファンドマネージャー」の実現が現実味を帯びている。さらに、小売業では、顧客の過去の購買データだけでなく、当日の天気やSNSのトレンドまでをAIが自ら調査し、在庫の補充からSNS広告の出稿までを一人で完結させる「自律型店長」の導入が進んでいる。中でも、最も劇的な変化が期待されているのが「製造業」の現場である。ここでは製造業を例に、従来のAIとAIエージェントで何が変わるのか、その具体像を想定して深掘りしたい(図3)。

- [図3]製造業などのビジネスにAIエージェントを導入することで生まれる新たな価値

- 作成:伊藤元昭(Googleの生成AI「Nano Banana Pro」を利用)

応用例1:止まらない工場の実現

これまでの製造現場におけるAIの役割は、「異常検知」が中心だった。その代表例が、いわゆる「予知保全」である。センサーデータを解析することで「モーターが1週間以内に故障する確率が高い」といった保全情報を管理者に通知(アラート)。管理者は実際に故障が起きる前に先回りして対処するというものだ。これが、AIエージェントを導入することで、故障の予兆を検知したら、AIが自律的に以下のようなステップを実行できるようになる。まず、社内在庫をチェックし、交換部品を自動で発注。部品の到着予定に合わせて、最も生産効率を落とさない時間帯にメンテナンス作業をスケジューリングする。そして、保守担当者のウェアラブル端末に「本日15時に、この手順で部品交換を行ってください」と、必要なマニュアルと共に指示を送る。こうした対処プロセスの中で、人間が行っている仕事は、AIが作成した計画を「承認」するだけである。AIが「手足」となって動き回ることで、ダウンタイム(稼働停止時間)を最小限に抑えることができる。

応用例2:サプライチェーンの「自己最適化」

現代の製造業を悩ませるのが、天災や地政学リスクによる供給網の分断である。ここでもAIエージェントは、従来の「予測ツール」を大きく超える力を発揮する。例えば、海外の主要港でストライキが発生したというニュースが流れたとする。AIエージェントは即座に、そのニュースを拾い上げ、自社の物流ルートへの影響を計算。人間が状況を把握する前に、「代替の輸送ルートの確保」や「部品不足を補うための生産順序の組み替え」を提案、あるいは事前に設定された権限の範囲内で実行まで移す。これまでベテラン社員の経験と勘に頼っていた「トラブル対応」を、AIが、リアルタイムで現実のデータに基づく全社最適化した方法で対処できるようになる。

応用例3:多様化するニーズへの「自律的対応」

顧客ごとに異なる仕様の製品を作り分ける「マスカスタマイゼーション」と呼ばれる製造業の新しいビジネスモデルがある。ただし、その実践には、製造工程の複雑化が避けられない課題となる。従来のシステムでは、生産品目を変更する都度に人間が生産ラインのプログラミングを書き換える必要があった。AIエージェントを搭載したロボットならば、口頭やテキストでの「次はこういう仕様の製品を作って」という曖昧な指示を理解し、自ら動作プログラムを生成・調整できるようになる。これによって、多品種少量生産のコストとスピードが劇的に改善され、製造業は「作る」だけでなく、顧客一人ひとりに寄り添う「サービス」へと変貌を遂げることになる。

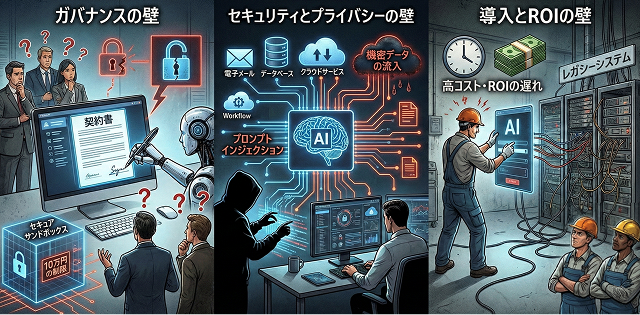

製造業でAIエージェントを活用する上での課題

ここまで挙げてきたAIエージェント活用の未来像は非常に魅力的なものばかりだ。ただし、AIの技術さえ進歩すれば明日からすぐに実現できるというわけではない。実務的な視点に立てば、いくつかの大きな課題、実現を阻む壁が見えてくる(図4)。

- [図4]AIエージェントの活用を阻む壁

- 作成:伊藤元昭(Googleの生成AI「Nano Banana Pro」を利用)

第1の壁は、「ガバナンスの壁」である。AIが自律的に判断し行動することに伴って、責任の所在が見えなくなるのだ。これまでのソフトウェアは、人間が入力した通りにしか動かなかった。しかし、AIエージェントは目標達成のために自律的に行動の筋道を選択していく。もしも、AIが「コスト削減」という目標のために、独断で長年の付き合いがある取引先との契約を解除してしまったら、その責任は誰が負うことになるのだろうか。あるいは、AIの判断ミスで大規模な誤発注が発生した場合、それはシステム部門の責任なのだろうか、それともAIに目標を与えた事業部門の責任なのだろうか。こうした問題が生じるのを防ぐため、実務においては、AIに与える「権限の範囲(サンドボックス)」を厳格に定義する必要がある。「10万円以下の発注なら自動実行、それ以上は人間が承認する」といったルール作りや、AIの思考プロセスを可視化する「説明可能なAI(XAI)」の導入が不可欠になる。技術以上に、組織としての倫理規定や法的なガードレールの整備が求められる。

第2の壁は、「セキュリティとプライバシーの壁」である。AIエージェントは、その能力を発揮するためにメール、スケジュール、社内データベース、さらには外部のウェブサービスなど、多岐にわたるデータにアクセスする権限を持つことになる。これは、サイバー攻撃者にとって「たった一つのAIを乗っ取れば、組織のあらゆる情報にアクセスできる」という絶好の標的になることを意味する。特に懸念されているのが「プロンプトインジェクション」と呼ばれる攻撃である。外部からAIに対して巧妙に細工された指示を読み込ませることで、AIを操り、機密情報を外部へ送信させたり、不正な送金を行わせたりできてしまうリスクが生じる。また、AIが自律的に外部ツールと連携する際、意図せず顧客の個人情報が学習データとして流出してしまう懸念も拭えない。実務担当者は、「AIが自律的に動けば動くほど、監視の目も高度化させなければならない」という逆説的な課題に向き合うことになる。

第3の壁は、「導入とROIの壁」である。AIエージェントがユーザーの手足として動くためには、社内の基幹システムや古いデータベースと円滑に連携できるようにしておく必要がある。ところが、多くの日本企業が抱えるシステムは複雑に絡み合い、AIが容易にアクセスできる状態にはない。このデータ整備のコストは膨大であり、目に見える成果が出るまでに時間がかかる。さらに、現場の心理的抵抗も無視できない。自分の仕事を自律的にこなすAIを「頼もしい相棒」ではなく「仕事を奪う敵」とみなす文化が根強い組織では、せっかく導入したAIシステムも形骸化してしまう。AIエージェントの導入は、単なるITのアップデートではなく、業務プロセスそのもの、そして、社員のマインドセットを根本から書き換える「組織変革(DX)」そのものとして取り組む必要がある。

AIと共に豊かになるためにユーザーに求められる「リスキリング」と「マインド」

生活やビジネスの様々な用途にAIエージェントが利用されるようになれば、作業や業務の効率や質が劇的に改善することだろう。ただし、その一方で、私たちが長年美徳としてきた「自ら手を動かして作業を完遂する」というスキルの価値を相対的に低下させるリスクもある。AIの活用効果を最大化するためには、ユーザーである人間側の業務の進め方と価値を再定義する必要が出てくる。私たちは「作業者」から、複数のAIエージェントを束ねて成果を出す「オーケストレーター(指揮者)」へと、スキルの転換が迫られることになると言える。そうした時代に適応するためには、ユーザー側に求められる以下のような3つのスキルを養う必要がありそうだ(図5)。

- [図5]AIエージェントを効果的に活用するためにユーザーに求められる3つのスキル

- 作成:伊藤元昭(Googleの生成AI「Nano Banana Pro」を利用)

スキル1:「AIマネジメント・スキル」の習得

AIエージェントは、プログラミングや複雑な数式を覚えなくても活用できる。最も重要なスキルは、「優秀だが、指示に忠実すぎる部下」であるAIを適切・効果的に扱うマネジメント能力である。AIは、何をすべきかを自分で決めることができない。ユーザー側には、「何を達成したいのか」「なぜそれが必要なのか」といった抽象的ビジョンを、AIが解釈可能な具体的な目標へと翻訳する力(目的設定能力)が求められる。また、大まかな目標を、AIが実行可能なステップに分解し、どの部分をAIに任せ、どの部分を人間がチェックするかを設計する力(業務プロセスの編集力)も必要だ。さらに、AIが出したアウトプットを鵜呑みにせず、論理的な整合性、倫理的な妥当性、自社のブランドに合致しているかを冷徹に判断し、修正を指示する「編集者」の力(批判的修正力)も不可欠になる。

スキル2:人間らしさへの回帰

AIが論理と効率を極めれば極めるほど、逆説的に、人間にしかできないことの希少価値が高まってくる。効率化によって生み出された時間を、AIとの共同作業を前提としてスキルの再構築に再投資する必要がありそうだ。まず、相手の感情を察し、心に寄り添った対話を行う、共感力とホスピタリティを養うこと。これは、金融のアドバイザリや、小売の接客、製造業におけるクライアントとの深い信頼構築において、AIが決して獲得できないスキルである。次に、「データ上は正しいが、社会的に見てこれは誠実か?」という倫理的判断や、「理屈抜きに心が動かされる」という直感的なセンスに基づいて意思決定するスキル。これらは、人間が人間として社会活動を行う上での「最後の砦」となる。AIは、作業の効率化と質の向上のために使い、人間は行う作業や業務の意味と価値を作る。こうした役割分担こそが、ビジネスをより人間味のある豊かなものに変えていくことだろう。

スキル3:アジャイルに学び、リスクを飼い慣らす

AIエージェントの効果的な活用にはユーザー側の行動や仕事を再定義することを前提とすれば、AIの適用はスモールスタート(小規模な試行)を心がける必要がありそうだ。人間は、AIのようには急に仕事の進め方や価値観を変えることはできないからだ。小さなプロジェクト、生活の中のささいな作業から適用を始めれば、たとえAIが判断ミスをしても致命傷にはならない。その失敗から「AIへの指示の出し方」や「管理のツボ」を学ぶこと(ラーニング・ループ)が、最大のリスクヘッジになる。小さな成功は、組織内の心理的抵抗を和らげる。AIは敵ではなく、自分を楽にしてくれる味方であるという実感を積み重ねることが、結果として効果的AI活用を加速させる。

AIエージェントだけでなく、ユーザーも共に成長していくことが重要だ。そうすれば、AIエージェントは、私たちの能力を拡張する、未来の生活やビジネスに欠かせない相棒となることだろう。

- Writer

-

伊藤 元昭(いとう もとあき)

-

株式会社エンライト 代表

富士通の技術者として3年間の半導体開発、日経マイクロデバイスや日経エレクトロニクス、日経BP半導体リサーチなどの記者・デスク・編集長として12年間のジャーナリスト活動、日経BP社と三菱商事の合弁シンクタンクであるテクノアソシエーツのコンサルタントとして6年間のメーカー事業支援活動、日経BP社 技術情報グループの広告部門の広告プロデューサとして4年間のマーケティング支援活動を経験。

2014年に独立して株式会社エンライトを設立した。同社では、技術の価値を、狙った相手に、的確に伝えるための方法を考え、実践する技術マーケティングに特化した支援サービスを、技術系企業を中心に提供している。

- URL: http://www.enlight-inc.co.jp/