JavaScriptが無効になっています。

このWebサイトの全ての機能を利用するためにはJavaScriptを有効にする必要があります。

- Science Report

- サイエンス リポート

五感を高め、拡張する

- 文/伊藤 元昭

- 2018.04.28

人工知能(AI)によってヒトの職業が脅かされる。そんな話題が頻繁に語られるようになった。知的能力だけでなく、周辺環境を検知する能力、そして身体能力の面でも、ヒトをはるかに上回る能力を持った機械が数多く存在している。ヒトが機械や道具を生み出す最大の目的は、自分たちの能力を強化・拡張することにある。原始時代に登場した石器も、SFの世界で夢想するサイボーグも、その点では同じだ。スマートフォンや自動車を自在に操る現代人は、100年前には考えもしなかった能力を既に身に着けている。人体改造こそしてはいないが、もはやサイボーグの一歩手前まで来ていると言えるだろう。本連載では、ヒトの能力を強化・拡張する技術について、第1回で知覚、第2回で身体能力、第3回で知的能力に注目し、ヒトの能力がどのように強化・拡張されていくのかを見ていく。

宇宙を飛び回る超人や悪の組織と戦う人造人間など、機械を使ってヒトの能力を強化・拡張するという舞台装置は、SFの定番である。ただし、こうした機械による能力の強化・拡張は、既に身近なところで数多く見られる。

ヒトは既にサイボーグになりかけている

例えば、かつては専門家だけが使う道具だったコンピュータは、ノートパソコン、スマートフォン、さらにはウエアラブル機器などが登場し、どんどんヒトに近い位置で使われるようになった。これによって、コンピュータの力をヒトの能力の一部として同化させ、文字通り手足のように利用している。そして、過去には知り得なかったより多くの情報を手に入れ、昔ならば出会うこともなかったような人と、密度の高いコミュニケーションを交わせるようになったのだ。

今、こうした強化・拡張した能力の活用を前提に生きる「デジタルネイティブ」が、次の暮らしや社会の担い手になりつつある。社会の進化もまた、機械によるヒトの能力の強化・拡張と共にあると言えるだろう。

機械によるヒトの能力の強化・拡張は、様々な切り口で進んでいる。例えば、知覚の強化・拡張では、「見る」「聞く」「触れる」「嗅ぐ」「味わう」といった五感を強化するだけでなく、本来ヒトが持たない検知能力まで付加するセンサー技術やICT*1技術が急速に発達している。さらに、身体能力の強化・拡張では、筋力や運動能力、持久力、耐環境能力、治癒力の強化・拡張をもたらす、ロボット技術などが高度化してきた。知的能力の強化・拡張では、記憶や情報処理能力、判断力、集中力、専門性の高いスキルの学習力を高めるための、AIのようなIT技術やブレイン・マシン・インタフェース(BMI*2)などが登場してきている。連載第1回の今回は、五感などヒトの知覚の強化・拡張につながる技術開発動向に話題を絞り、その最前線を紹介したい。

知覚の強化・拡張に欠かせない技術とは

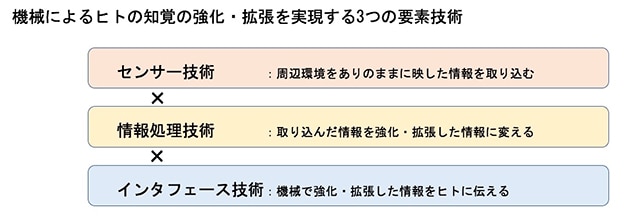

機械による知覚の強化・拡張とは、すなわちセンサー技術の進化だと考える人は多いかもしれない。もちろんセンサー技術は重要だ。しかし、それだけでは足りないのだ(図1)。

|

知覚とは、感覚器官から得た情報から、周辺環境の出来事や状態、そこでの変化などを把握することを指す。そのため、周辺環境をありのままに映した情報を取り込むためのセンサー技術に加え、取り込んだ情報の中から価値の高い情報を抜き出す情報処理技術が必要になる。さらにこうした知覚を機械で強化・拡張するには、機械で取り込んだ情報をヒトの感覚器(目、耳、鼻、皮膚、舌など)を介して伝えるインタフェース技術も欠かせない。

現在、知覚の強化・拡張につながるセンサー技術と情報処理技術、インタフェース技術のそれぞれにおいて、同時進行で革新的進化が起きている。ヒトの能力を強化・拡張する技術は、かつてないほどの飛躍を遂げつつあるのだ。特に、ヒトが本来持っている能力を高める“強化”ではなく、ヒトが本来持っていない能力を獲得する“拡張”につながる技術の進歩が著しい。

センサーのIoT化で、ヒトの視覚の呪縛を解く

ヒトの能力を強化・拡張する技術の研究開発は、あらゆる種類の知覚を対象にして行われている。中でも、顕著に進んでいるのが視覚分野である。ここからは、視覚の強化・拡張につながる、センサー技術、情報処理技術、インタフェース技術それぞれの研究開発の動きを紹介していく。

視覚を機械で再現するには、画像を取り込むイメージセンサーが欠かせない。これまでのイメージセンサーは、ヒトの目の機能を強化する方向への進化が中心だったと言える。より詳細な画像を取り込むための画素数の向上は、視覚に照らして解釈すれば、視力を高めることに相当する。小さな対象物でも、画素数の多いイメージセンサーならば細かいところまで克明に識別できるようになる。感度の向上や赤外領域画像の取り込みは、夜目が利くようにするための工夫だ。画像の取り込み速度の向上は動体視力を高め、取り込み画像データの多ビット化は色覚の向上につながる。

最近では、IoT関連技術が発展したことで、ヒトの視覚の範疇を超えた新たな視覚を実現できるようになってきた。イメージセンサーをありとあらゆるところに配置して、遠く離れた場所や、隠れていて見えなかった場所の様子まで知ることができるようになったのだ。

これまでも監視カメラを使えば、特定の場所の様子を知ることができた。しかし、それを利用できたのは一部の人だけで、誰でも利用できるわけではなかった。それが今では、インターネットにつながるライブカメラが多数配置されたことで、渋谷のスクランブル交差点を渡る人、国際宇宙ステーション(ISS)から見える地球など、様々な場所の様子を誰でもリアルタイムで見られるようになった(図2)。このような拡張した新しい視覚は、一昔前ならば千里眼や透視能力に類したものだっただろう。

|

人間の視覚では、近くの物は大きく詳細に見ることができるが、遠くの物は小さく粗くしか検知できない。しかし、IoT化したカメラを駆使すれば、遠くのモノでも詳細に見ることが可能になる。これは、機械の目だけが持つ利点だ。だからカメラを世界中に設置すれば、ヒトの目に代わって機械の目が、世界中の様子を詳細に捉えてくれる。

情報処理のAI化で、雑然とした情報から目標物を見つけ出す

画像の中から必要な情報を得るために欠かせない情報処理技術では、AIによる機械学習の進歩が著しい。AIを使えば、人間の脳を使った処理ではとても得られないような情報を、極めて迅速に探り出すことができる。

人は雑然とした絵面の画像の中から、意味のある情報を抽出したり、探し物を見つけたりする作業が、必ずしも得意ではない。雑踏に紛れ込んだ赤と白の縞模様の服を着たキャラクターを探す、「ウォーリーを探せ」という絵本がある。この絵本を多くの人が楽しいと感じるのは、ヒトがこうした作業を不得意としているからだ。しかし、現在のAI技術を使えば、絵本の面白みが全く感じられないほど簡単に、ウォーリーを探し出すことができる。

ヒトは、細かい部分まで克明に記した情報よりも、単純化した情報の方が内容をすんなりと理解できるようになっている。例えば、道案内をする時、情報量の多い詳細な地図よりも、デフォルメして目印だけを記した経路図を使って説明した方が、多くの人にとって分かりやすい。しかし情報処理技術の助けを借りれば、詳細な情報の中からでも必要な情報をはっきりと認知できるようになる。こうした技術は既に、雑踏の中から不審者を見つけ出して、テロの発生を未然に防ぐといった用途に使われている。同じ能力を、ヒトが視覚の拡張として手軽に使えるようになると、生活や仕事で大いに役立つことは間違いない。

情報処理を高度化し、部屋の音から場の空気を読む

また、特に高度なセンサーを使わなくても、情報処理技術を組み合わせて活用することで、全く新しい知覚を生み出せるようにもなった。

見えにくいビジネスの動きや社会活動の様子を数値化し、グラフにして問題点を明確にあぶり出す管理手法を「見える化」と呼ぶことがある。IoTの代表的な応用であるスマートファクトリーやスマートホームなどでは、まさにこの見える化を目的として最先端の情報処理技術を活用している。見える化した情報を、パソコンなどに映し出すのならば管理手法の範疇にとどまるが、ウエアラブル機器などを介してヒトに伝えることができれば、ヒトの新たな知覚となる。

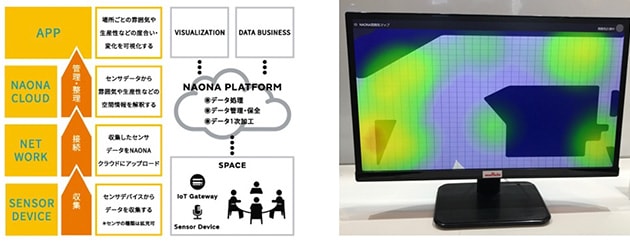

既に、見える化を活用するための様々な取り組みは、各所で行われている。例えば村田製作所は、雰囲気や親密度などの定量化しにくい情報をデジタル化・可視化する、「NAONA」という見える化プラットフォームを開発し、その実証実験を開始した(図3)。部屋や建物の様々なところにマイクを配置し、そこから得たデータを解析することで、場の雰囲気や盛り上がり、人間同士の親密度などを検知する。言わば、場の空気を読むような、五感では単純に説明できない複合的知覚を再現する試みだ。検知するデータは、マイクから得られる部屋の音の大きさや周波数など比較的単純なものである。

|

現在、同社が対象にしているのは、部屋の中など人間の五感が及ぶ距離感の領域だが、検知するセンサーを世界中に配置すれば、国を越えて広域の場の空気を読むために活用できるだろう。この技術を応用すれば、世界中の世論や時代の気分などを、拡張した人の知覚を通して知ることができる可能性が高い。そのインパクトは、金融取引や商品のマーケティングのような経済活動から、世論調査やそれを利用した政治活動など、多方面に及ぶ可能性がある。

心の動きを見透かす未来の視覚

また、特殊なセンサーと高度な情報処理技術を組み合わせれば、これまで知覚できなかった隠れた情報を得ることができるようにもなる。

例えば、ヒトが何を考え、感じているのかといったことを、外部から見透かす。そんな読心術のような視覚を、機械で実現できるようになってきた。これには、ヒトの脳の活動を非侵襲で知ることができる、機能的磁気共鳴映像(fMRI*3)と呼ばれる技術を用いる。この技術で、脳のどの部分が活動しているのかを検知し、あらかじめ用意された活動パターンのデータベースと照合することで、被験者が何を考え、感じているのかを推定する仕組みだ。既に、アメリカ最大のスポーツイベントであるスーパーボウルのテレビ中継において、fMRIを使って最も前向きな感情を引き出したCMを特定したという活用例がある。

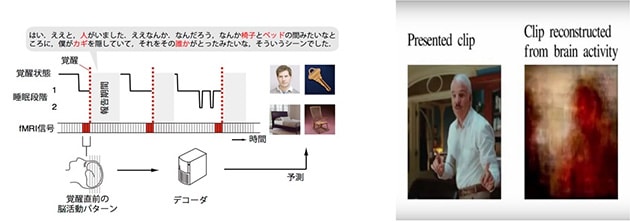

また、国際電気通信基礎技術研究所(ATR)では、眠っている間に見ている夢の内容を解読することに成功している(図4)。まず、被験者に様々な図形や絵を見せてこれを思い浮かべさせ、そのときの脳の活動パターンを記録してデータベース化する。そして、眠っている被験者が夢を見ている時の脳の活動パターンを検知し、データベースと照合することで夢の内容を特定するというわけだ。カリフォルニア大学バークレー校では、見ているモノの輪郭や質感、色、濃度などによる脳の活動パターンを蓄積しておくことで、被験者が見ているモノを映像化することにも成功している。この技術は、被験者が実際に見ているモノだけではなく、夢や幻覚も同じ方法で映像化することができるため、医療など様々な分野への応用が期待されている。

|

機械とヒトの距離感が縮まり、能力の一体化が進む

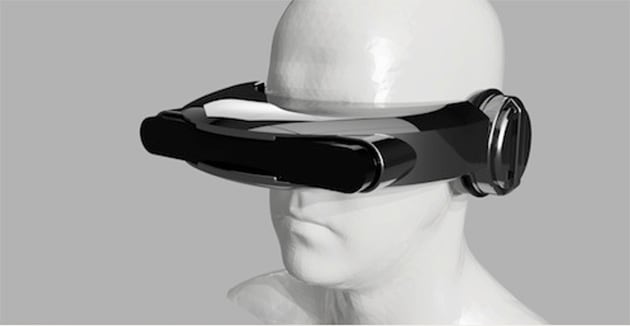

機械によって強化・拡張した知覚をヒトに伝えるインタフェース技術では、機械で作った状況を高い臨場感で伝える仮想現実(VR)や、現実の知覚情報に機械で作った情報を重ねて見せる拡張現実(AR)の分野の発達が著しい。機械によって高められた視覚は、ヘッドマウントディスプレイ(HMD)やスマートグラスによってヒトと一体化し、あたかも自分本来の視覚のように感じさせるまで成熟してきている。

近年では、家庭用ゲーム機向けのHMDが普及してきた。VRやARに向けたその技術は、単に映像を映し出すだけではなく、拡張した視覚をヒトに伝えるべく高度な進化を遂げている。例えば、アメリカ陸軍の研究機関は、戦場の兵士がゴーグルを着用して活用する新たなARシステム「Tactical Augmented Reality」を開発した。これは近い将来、実際に利用可能な状態になると言われ、そのイメージ映像も公開されている(図5)。サングラスサイズのメガネ型ARデバイスに、兵士が潜入する建物内の見取り図を表示し、そこに自分の位置や仲間の位置を俯瞰して映し出す。さらに、雑踏の中からターゲットを一目で判別する機能なども備えているという。

|

知覚を拡張する機械とヒトの距離が縮めば縮むほど、機械とヒトの一体感は高まる。そして、この発想を突き詰めると、機械をヒトの体の中に埋め込むインプラントデバイスに行き着く。これは、サイボーグを目指すことにほかならない。ただし、医療目的以外で機械を体の中に入れることに抵抗がある人は多く、実用化されたとしても市場が拡大する可能性は低いという意見が支配的だ。2005年にアメリカでは、患者の情報管理など医療を目的として、RFIDチップの体内移植を食品医薬品局(FDA)が認可した。その後、身分証明証やルームキーとしても使えるようになったが、実際には普及が進んでいない。

ヒトの五感の特性を新しい知覚に変える

機械で強化・拡張した知覚をヒトに伝えるインタフェース技術を応用して、新たな知覚を作り出す動きもある。

ヒトの五感には、それぞれ固有の特性がある。視覚は、正確で詳細な情報をヒトにもたらす。しかし、何かをしている最中に別の情報を挟み込むのには、聴覚表現の方が適している。非常時の注意喚起の際には、必ず音による警報が使われるのはこのためだ。また、嗅覚は、人間の過去の記憶と特に強いつながりを持っていると言われる。こうした情報を受け取るヒトの五感の特性を生かし、新たな知覚を創出する取り組みも出てきている。例えば、視覚情報として伝えるべき映像を、あえて音声情報として伝えることで、新たな機能や用途が生まれる可能性があるのだ。

東京大学のグループは、視覚情報を音に変えて、空間の広がりや置かれているモノの配置や種類を把握できるウエアラブルデバイス「Sight」を開発した(図6)。身の回りの空間は広がりを持った3次元の世界だが、視覚では両眼視差により立体感は分かるものの、空間の広がりを的確に把握するのには向いていない。イルカやコウモリは超音波を発し、その反響音を感知することで周囲の状況を知る反響定位(エコーロケーション)という能力を持っている。Sightは、このエコーロケーションを人間にも身に着けさせることを狙ったデバイスだ。まず、可視光カメラを使って周りのモノの配置を知り、赤外光3Dカメラの画像から空間の広がりを推定する。そして、モノの種類や位置を、聴きやすくリズムのある音に変換するのだ。例えば、狭い空間では大きな音が、広い空間では小さな音がする(参考資料1)。

|

他人や動物、モノに憑依して得難い体験を得る

また、機械によって知覚を自由自在に強化・拡張できるということは、機械を介してヒト同士の知覚を交換できるということでもある。他人に憑依し、知覚を乗っ取って、自分では体験できない世界を知ったり感じたりすることができるのだ。相手はヒトではなく、動物やモノでもよい。ダイオウイカが見ている景色を見ながら深海を泳ぎ、惑星探査機のカメラ映像を見ながら宇宙空間を飛ぶといった体験もできるのかもしれない。

東京大学の暦本純一教授は、このように拡張した知覚を身に着けたヒトを「拡張人間(Augmented Human)」と呼んでいる。自身の知覚では得ることができない拡張人間の体験は、コンピュータ・シミュレーションの力を借りた擬似的な体験とは異なり、自分の力で実際に体験したと感じられるものだ。暦本教授のグループでは、ドローンのカメラ映像を見ながら空中を動き回ることができるシステムなど、拡張人間を実際に試作して、その効果を試している。こうした技術は、専門的なスキルの習得や属人性の高い技能による遠隔操作などで、大いに効果を発揮することだろう。

今回は、ヒトが持っている能力のうち、情報をインプットする知覚に注目し、それを機械によって強化・拡張する技術を紹介した。次回は、仕事や表現などアウトプットする能力や、体の強さにつながる身体能力の強化・拡張に向けた技術を紹介する。

[第2回へ続く][ 脚注 ]

- *1ICT

- Information and Communication Technologyのこと。

- *2BMI

- ロボットやコンピュータなどを脳と直接つなぐための技術。手足や口を介さずに、考えたことを直接機械に伝え、操作や命令、情報の入力に用いる。義手の操作や精神疾患の治療のような医療以外にも、操縦者の意思を迅速に伝え動かす工作機械や乗り物への応用を想定し、技術開発が進められている。

- *3fMRI(functional magnetic resonance imaging)

- 磁気を利用して臓器や血管を撮影するMRIを応用し、脳や脊髄の活動に関連した血流の増減を視覚化する技術。その基本原理である「BOLD効果」は、東北福祉大学 特任教授の小川誠二氏がベル研究所に在籍していた時代に発見した。

[ 参考資料 ]

- 1. 「音を使って見る」ウエアラブルデバイス「Sight」の解説資料

- http://thesight.jp/press/SightLeaflet201510.pdf

- Writer

-

伊藤 元昭(いとう もとあき)

-

株式会社エンライト 代表

富士通の技術者として3年間の半導体開発、日経マイクロデバイスや日経エレクトロニクス、日経BP半導体リサーチなどの記者・デスク・編集長として12年間のジャーナリスト活動、日経BP社と三菱商事の合弁シンクタンクであるテクノアソシエーツのコンサルタントとして6年間のメーカー事業支援活動、日経BP社 技術情報グループの広告部門の広告プロデューサとして4年間のマーケティング支援活動を経験。

2014年に独立して株式会社エンライトを設立した。同社では、技術の価値を、狙った相手に、的確に伝えるための方法を考え、実践する技術マーケティングに特化した支援サービスを、技術系企業を中心に提供している。

- URL: http://www.enlight-inc.co.jp/