盲目の人が「音で見る」

2014.5.2

|

視覚障害者が、視覚を取り戻すためには様々なアプローチがある。眼球の代わりとなるレンズに入った光を電気信号に変え、脳に伝えるという人工視覚の研究は世界各地で進められており、iPS細胞による網膜再生も臨床研究がすでに始まっている。

また、これらの工学的、医学的なアプローチとはまったく別のやり方で、「視覚」を実現する方法も以前から研究されてきた。

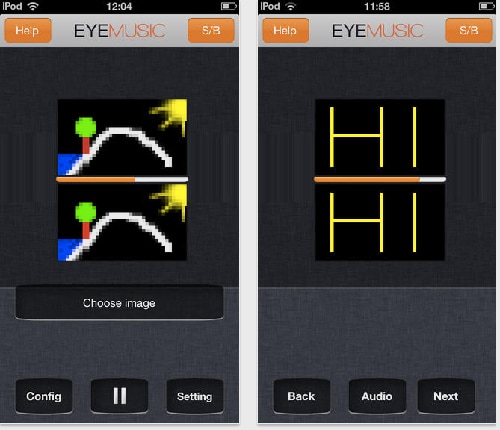

1992年に、オランダのPeter Meijer博士が開発した「vOICe」は、画像を音に変換して「見る」ためのシステム。vOICeでは、画像を左から右にスキャンし、特定のルールに従った音を出す。例えば、左下から右上に伸びる直線があったら次第に高くなる音が発生する、といった具合だ。70時間程度のトレーニングを行えば、単純な点や線だけでなく、人間の顔や街頭の風景など、複雑な画像も認識できるようになる。頭にカメラを装着すれば、身の回りの光景を音として「見て」、歩き回ることも可能だ。

イスラエル ヘブライ大学の神経科学者であるAmir Amedi博士らは、2007年からvOICeを利用した研究進めている。vOICeシステムを装着した被験者に、人間がさまざまなポーズを取っている画像を見せて(つまり音に変換して聞かせて)、その時に脳でどのような活動が行われているのかをモニターしたところ、従来の仮説とは異なる発見があったという。

これまで、脳の各領域は視覚、嗅覚、触覚など、それぞれの感覚に対応していると一般的に考えられてきた。そして、もし各領域が対応する感覚のために使われない場合は、別の感覚を強化するために使われるとも考えられていた。生まれつき視覚に障害がある人の視覚野は、聴覚を補助するために使われるという仮説だ。

しかし、vOICeを使った実験では、被験者である視覚障害者の視覚野にある特定の領域が活発に活動していたという。視覚野は人型を認識するために使われることで知られており、従来の脳モデルでは、人間が成長する過程で視覚的な経験を重ねないと、人型を認識できるようにならないと考えられていたが、これが崩れたことになる。どうやら、視覚野は視覚的な情報だけを処理しているのではないらしい。入力される情報が音であろうが映像だろうが、人型を認識する領域は同じようだ。今後はこうした知見に基づいて、脳の新しいモデルが作られていくことになるだろう。なお、Amedi博士らの研究チームは、研究成果を元に「EyeMusic」というiPhone用アプリを公開している。EyeMusicでは、画像の色についても「音で見る」ことが可能だ。