Science Newsサイエンスニュース

口パク動作を行うだけで発話内容を認識

2019.6.10

|

音声認識を使ったユーザーインターフェイスは、私たちの日常にずいぶん浸透してきた。スマホやパソコンで文字入力する時などに音声認識を使うケースは増えているし、スマートスピーカーも世界的にベストセラー商品になっている。少なくとも家の中であれば、スマートスピーカーのようなデバイスに対して話しかけることも抵抗はなくなってきているといえるだろう。

とはいっても、スマホに話しかけているプライベートな内容を、他人に知られてもいいという人は少数派なのではないだろうか。音声認識がユーザーインターフェイスのメインストリームにならない理由として、この点が大きいように思われる。

東京大学とソニーコンピュータサイエンス研究所からなる研究チームが開発した技術「SottoVoce」(ソット・ヴォーチェ)は、音声ユーザーインターフェイスに一石を投じることになりそうだ。

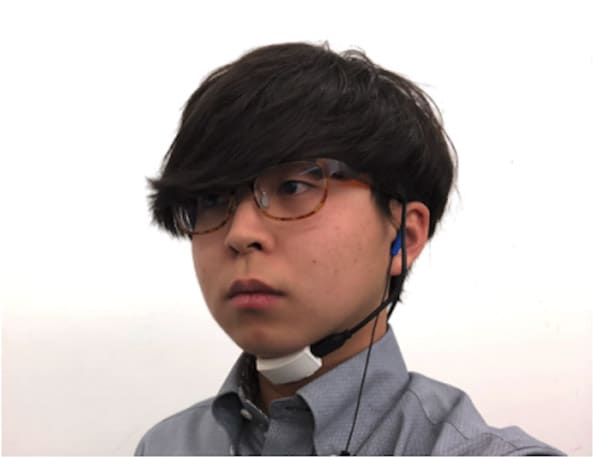

SottoVoceは、超音波エコー映像とディープラーニングを組み合わせた技術である。利用者の顎の下に超音波イメージングプローブを取り付けて口腔内の情報を取得。利用者が声帯を振動させずに発話した、発生内容を認識するようになっている。

超音波画像からディープラーニング技術によって音響特徴ベクトルを生成。さらにこの音響特徴ベクトルを実際の音声波形に復元して、オーディオスピーカーから再生する。声を出さずに発話した内容が実際の音声として出力されるわけだ。こうして出力された音声を使い、実際の発話と同様にAmazon Echoなどのスマートスピーカーをコントロールすることにも成功した。

実用化されれば、声帯を損傷して声を出せなくなった人にとっての福音になるのは間違いない。また、音のない「声」で自由にデバイスをコントロールできるようになれば、これまでの音声ユーザーインターフェイスの課題が解決される可能性もある。

イヤホンを耳に付け、ファッショナブルなスマートチョーカーを首に巻くのが、数年後にはトレンドになっているかもしれない。