連載02

ブラックボックスなAIとの付き合い方

Series Report

事故が起きた際の責任の所在が分からない

今後は、AIの判断理由を明確にしたい用途が次々と登場してくることになりそうだ。その典型が自動運転車である。

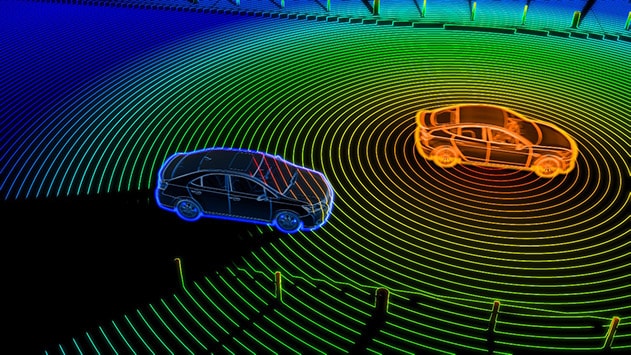

自動運転車では、カメラの画像や超音波レーダー、LiDAR(レーザー光のレーダー)などで検知したデータを基に、AIが解析して走行環境の状況を把握する(図6)。前述したように、画像認識の認識率は、既にAIが人間の認知能力を凌駕するレベルに達している。このため、自動運転技術が進歩すれば、人間の運転よりも事故を起こす確率は下がることだろう。

|

しかし、そんなAIも、100%正しい判断を下せるわけではない。また、何らかの人為的な原因で、自動運転車での避けられない事故が起きる可能性もある。こうした場合に、事故の原因を明らかにできないと、責任の所在が定まらなくなってしまう。これでは、保険の支払いもできない。事故の原因をすべて自動車メーカーに押し付けたら、おそらく自動運転車はビジネスとして成立しないだろう。

また、自動運転技術を進歩させるためには、その判断に誤りがあれば、当然、誤りを起こした理由を探り出して、改善していく必要がある。しかし、AIで下した判断の理由が分からなければ、改善の方向性を定めることが困難になる。

私たちがタクシーやバスを利用する際は、運転手に自分の命を預けている状態にあるといえる。それでも安心して乗っていられるのは、運転手の技能を信頼しているだけでなく、事故が起きた際にはその原因を運転手がきっちりと把握し、場合によってはその運転手自身が職を失うような責任を負って仕事していることを知っているからだ。AIが仮に事故を起こしたとき、「事故原因は不明だが、念のため該当するAIのスイッチは消しました」という説明で納得する被害者はいないだろう。

人間だって判断理由を的確に説明できない

ブラックボックス化した解答マシーンであるAIを、人の人生や命にかかわる問題に適用するのは躊躇する人が多いことだろう。しかし、近年、「判断理由を必ずしも説明可能にする技術の確立を待って、応用を考える必要はないのでは」とする意見も出てきている。なぜならば、人間の判断が重要視される仕事でも、判断理由が不確かなまま動いている例が多いからだ。事故や誤認が起きた際の対処を、法律や保険など技術とは別の仕組みで補うことができるのではという考え方だ。

自動運転車の導入によって、交通事故は間違いなく減ることだろう。その他の応用分野でも、機械が人間よりも優れた判断をする時代の到来が目前に迫っている。人間よりも正しい判断をするブラックボックス化した解答マシーンであるAIとどのように付き合ったらよいのかは、近未来を生きる私たちに突き付けられる大きな課題となることだろう。次回、連載第2回では、AIとのよりよい付き合い方を模索する様々な業界の動きを紹介する。

Writer

伊藤 元昭(いとう もとあき)

株式会社エンライト 代表

富士通の技術者として3年間の半導体開発、日経マイクロデバイスや日経エレクトロニクス、日経BP半導体リサーチなどの記者・デスク・編集長として12年間のジャーナリスト活動、日経BP社と三菱商事の合弁シンクタンクであるテクノアソシエーツのコンサルタントとして6年間のメーカー事業支援活動、日経BP社 技術情報グループの広告部門の広告プロデューサとして4年間のマーケティング支援活動を経験。

2014年に独立して株式会社エンライトを設立した。同社では、技術の価値を、狙った相手に、的確に伝えるための方法を考え、実践する技術マーケティングに特化した支援サービスを、技術系企業を中心に提供している。