連載02

ブラックボックスなAIとの付き合い方

Series Report

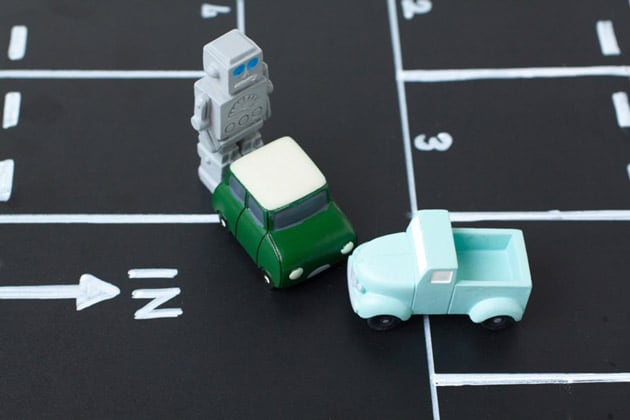

自動運転車が起こした事故の責任は誰が負う

AIを搭載した自動運転車やロボットなどでは、どんなにメーカーやユーザーが安全に気を配っても、避けられない事故や不具合が発生する可能性がある。その責任は誰が負うべきなのか。ここからは、AIを活用したシステムの不具合や事故の責任の所在について、最も検討が進んでいる自動運転車を題材にして議論したい。

既に、自動運転車の事故例が複数件ある(図5)。2016年2月、歴史上初めての自動運転車側に過失がある公道上での交通事故が発生した。グーグル(Google)が試験運転中の自動運転車が路線バスと接触事故を起こしたのである*2。さらに、2018年3月には、Uberの自動運転車が歩行者に衝突、初めての死亡事故が起きてしまった*3。その他にも、小さな事故は頻繁に起きているようだ。

|

さて、こうしたAIを搭載した自動運転車が起こした事故の責任は、誰が追うことになるのだろうか。クルマを運転している自動運転システムは、人間のようには雄弁に話せない。このため、多くの場合、事故が起きれば、ドライバーも被害者も自動運転車に何らかの過失があると主張することだろう。ところが、クルマに搭載されているAIは、判断プロセスがブラックボックス化している。自動車メーカーの責任を追及することも、潔白を晴らすことも困難な状態になる。

この点がクリアにならない限り、自動運転車に乗ろうという人は出てこないだろうし、メーカーも市場投入に腰が引けることだろう。さすがにこのままでは困るということで、自動運転車の普及を前にして、この点についての検討が着々と進んでいる。

原則的に事故の責任は所有者が負う

日本政府は、2018年3月、首相官邸が開催する未来投資会議の中で「自動運転にかかわる制度整備大綱」を示した。この中で、自動運転中のクルマの事故では、原則的にクルマの所有者に賠償責任を負わせる方針を決めた。要するに、一般自動車と同じ扱いである。ただし、外部からクルマのシステムに侵入するハッキングで事故が発生した場合には、損害を政府が補償するのだという。これは、自動運転に関する賠償制度の土台を早期に固め、メーカーが過大な責任を負う懸念を払拭して、事業化を急ぐことを狙った決定だ。ただし、これは非常時にはドライバーが自動運手システムから運転を引き継ぐ、レベル3自動運転*4車までが主な対象となっている。すべての事態にシステムが対処するレベル4以上に適用する責任の所在の決定は棚上げしている。

自動運転車やロボットでは、制御に関わるAIの暴走に備えて、システム全体の機能を停止させる「キル・スイッチ」を搭載すべしとする議論がある。しかし、暴走した機械を止めればそれで万事解決というわけでもなさそうだ。遠くない将来には、多くのAIが連動しながら全体として秩序あるシステムとして動くような時代がやってくるだろう。例えば、自動運転車の群れが最適走行している時に、1台の自動運転システムを停止したらどうなるだろうか。おそらく、不具合を起こしたクルマ以外にも、事故が波及する可能性が生じるだろう。また、通常AIの判断の方が人間の判断よりも優れているため、システムを無闇に停止して、判断能力に劣る人間に引き継ぐのはなまじ危険とする意見も出ている。

AI自賠責保険という新たなアプローチ

レベル4以上の自動運転車が実現すれば、不注意の多い人間が運転している場合に比べれば、ずっと交通事故が減ることがほぼ確実。しかし、その半面で、わずかながら起きる事故の損害賠償責任を誰が取るのか、改めて問題になる。ドライブレコーダーなどの搭載が義務づけられれば、状況証拠は豊富にそろうかもしれない。ただし、AIによる判断プロセスのブラックボックス化によって、明確な事故原因の追及が困難な状況は残されたままだ。自動車メーカーは、いかなる事故においても、自らに責任がないことを徹底的に主張することだろう。こうした状況下でも、少なくとも、事故の被害者が賠償されないまま放置されるようなことはあってはならない。

ここで、自賠責保険のような、自動運転車を対象とした新たな保障制度を設けるという案がある。事故原因の説明が不可能であることを前提として、自動運転車の事故を自然災害と同列に扱い、搭乗者もメーカーも開発者も誰も悪くないと考えるアプローチである。実際の運用では、搭乗者とメーカーが加入を強制されるような保険の立ち上げが考えられるだろう。同様の保険は、自動運転車だけでなく、ロボットなど様々なAI搭載機器を対処にして、拡大するかもしれない。

これは一見妙案であるようかに思えるのだが、実は大きな問題を抱えている。本来罰せられるべき過失を犯した人物がいた場合、無罪放免になってしまうことだ。特に、悪意を持った人物が事故を仕掛けても、洗い出すことが難しくなる。たとえ、AI自賠責保険が義務付けられるようになっても、この点を払しょくするための方法の模索は必要になる。

では、どうしたらよいのか。次回、連載第3回では、必要性に後押しされて様々な企業が着手し始めた、AI内部での判断プロセスを透明化するための技術開発の動きを紹介する。

[ 脚注 ]

- *2

- 2016年2月14日にアメリカのカリフォルニア州マウンテンビューの公道で発生したグーグル社開発中の自動運転車と路線バスの接触事故。自動運転車が路肩の砂袋を検知したことによって自動運転車は一時停止し、その砂袋を避けて前進するために左方向に車両を動かしたとき、後ろから走行してきたバス車両の側面にぶつかったという。カリフォルニア州の発表では、グーグル側の自動運転車は時速3キロ以下、バスは時速24キロだった。自動運転車の運転手にもバスの乗客15人にもけがはなかった。

- *3

- 2018年3月18日、アメリカのアリゾナ州で、ウーバーテクノロジーズ社の自動運転車が、自転車を押しながら車道を渡っていた49歳の女性歩行者を時速約64キロではねて死亡させる事故を起こした。自動運転において世界で初めて歩行者を死亡させた事故。この事故に関して、米道路安全保険協会(IIHS)が2018年10月、ベース車両に使われていたボルボ社の安全システムが解除されていなければ事故を回避できた可能性がある、という見解を示している。

- *4

- レベル3自動運転:米国の自動車工業会(SAE)が、走行中のドライバーとシステムそれぞれの関与の度合いを尺度に自動運転技術を6段階にレベル分けしたもののうち、「限定条件の下でシステムがすべての運転作業を行うが、緊急事態が発生した際などにはシステムの要請によってドライバーが操作を引き継ぐ」ことを想定した自動運転技術。

Writer

伊藤 元昭(いとう もとあき)

株式会社エンライト 代表

富士通の技術者として3年間の半導体開発、日経マイクロデバイスや日経エレクトロニクス、日経BP半導体リサーチなどの記者・デスク・編集長として12年間のジャーナリスト活動、日経BP社と三菱商事の合弁シンクタンクであるテクノアソシエーツのコンサルタントとして6年間のメーカー事業支援活動、日経BP社 技術情報グループの広告部門の広告プロデューサとして4年間のマーケティング支援活動を経験。

2014年に独立して株式会社エンライトを設立した。同社では、技術の価値を、狙った相手に、的確に伝えるための方法を考え、実践する技術マーケティングに特化した支援サービスを、技術系企業を中心に提供している。